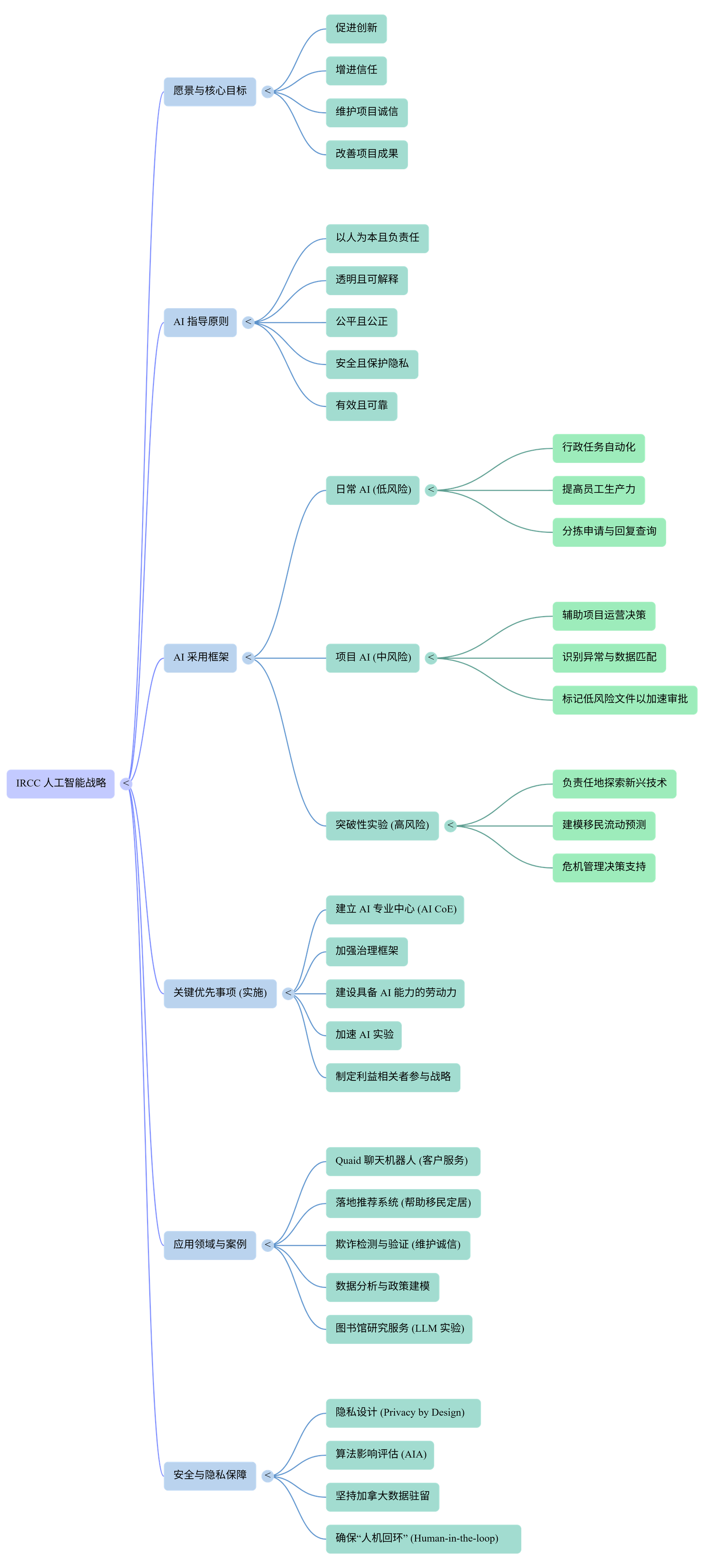

1. 导言:为什么加拿大移民部的AI战略值得中国政务决策者关注?

2026年2月,加拿大移民、难民及公民部(IRCC) 正式发布了其首份《人工智能战略》(AI Strategy)。这不仅仅是一次技术升级,更是为了重塑服务体验。

在全球政府数字化转型与智能化升级的进程中,加拿大移民部IRCC 已成为全球政务AI应用的标杆。IRCC的AI探索始于2013年成立的高级分析解决方案中心(AASC)。关键的治理里程碑发生在2017年,当时高层管理人员批准利用AI模型生成“if-then”自动化规则以应对激增的临时居民签证(TRV)需求。此后,IRCC在AI应用深度与透明度上持续领跑:其自动化系统已累计评估超过700万份申请,2020年上线的邮件分拣系统每年处理约400万封咨询邮件。特别值得关注的是,IRCC发布的“算法影响评估(AIA)”报告数量超过了加拿大任何其他联邦部门,充分体现了其在透明化治理方面的全球领先地位。

对于中国正大力推进的“数字政府”建设、数据要素价值化及各级部门AI规划而言,IRCC的实践具有极高的工程指导意义。它不仅解决了海量政务数据的高效分流问题,更在“行政裁量权”的法律边界内,示范了如何通过制度设计规避技术黑箱。

IRCC AI战略核心愿景: “IRCC利用人工智能的变革力量,促进创新、提升信任、维护项目诚信并改善项目成果。”

——————————————————————————–

2. 顶层设计:构建“以人为本”的AI治理基石

IRCC将AI视为赋能工具而非替代者,通过“AI指引原则”和“AI宪章”构建了一套严密的伦理与法律防火墙。

AI核心原则解析

IRCC确立了五项核心原则,指导AI全生命周期的合规运作:

| 核心原则 | 政务应用解释 |

| 以人为本与问责 | 确保AI服务于公众利益,维护基本权利,实施“真人参与(Human-in-the-Loop)”机制以减轻系统误差。 |

| 透明与可解释 | 避免“黑箱模型”,确保申请人有权获得行政决策的解释,了解系统逻辑与数据输入。 |

| 公平与公正 | 主动预防并纠正数据与算法模型中的偏见,重点保护边缘化群体,确保产出结果的普适性。 |

| 安全与隐私保护 | 严禁在公共AI工具中输入敏感数据,实施“隐私设计”并确保数据安全驻留在受控环境内。 |

| 有效与可靠 | 必须使用多元化、高质量且具有代表性的训练数据,通过持续监测确保产出结果的一致性。 |

AI宪章(AI Charter):核心守则与承诺

IRCC通过10项承诺明确了技术应用的红线。重点包括:

- 人类始终拥有监督权: AI系统绝不自主运行,必须受人类监督以确保符合法律框架,部门对AI的所有行为承担最终法律责任。

- 严禁视觉追踪: 明确承诺“不使用视觉技术进行个人画像、定向或追踪”,以保护公民基本权利。

- 公共利益导向: 所有AI系统的设计初衷必须是改善公共服务。

合规框架

IRCC通过与财政部秘书处合作,严格执行《自动化决策指令》。其核心工具是“算法影响评估(AIA)”,通过公开披露算法的风险级别与减缓措施,IRCC赢得了公众对其自动化审批系统的信任。

——————————————————————————–

3. 操作路径:政府部门如何把AI“真正用起来”?

IRCC采用“分类分级”的实施逻辑,通过其“AI采用框架(Framework for AI Adoption)”明确了不同场景的技术边界。

场景分级应用模型

- 日常应用(Everyday AI): 聚焦行政生产力。主要处理简单、重复且对客户风险极低的行政任务。例如利用“调阅及隐私(ATIP)分析支持工具”辅助脱敏、生成文档摘要或响应常见查询。

- 业务程序应用(Program AI): 侧重辅助决策。AI通过识别异常、匹配数据、标记低风险文件来提升业务效率。IRCC在此设定了明确的行政红线:AI工具不拒绝、也不建议拒绝任何申请。 所有的拒绝决策必须由人工官员根据其行政裁量权做出。

- 突破性尝试(Experimental AI): 侧重预测建模。例如利用AI预测移民流向及其对加拿大经济的潜在影响。目前此类应用多处于实验阶段,尚未直接介入核心行政程序。

技术全景

在技术架构上,IRCC将机器学习(ML)计算机视觉(CV)(验证护照与防作弊)、自然语言处理(NLP)(邮件分拣与智能助手)及生成式AI(GenAI)(内部知识检索)深度交织。这种“智能自动化”超越了传统的固定规则引擎,具备更强的自适应能力。

——————————————————————————–

4. 落地案例:从场景选择到成效评估

IRCC为中国政务信息化部门提供了多个可直接对标的业务场景:

- 智能客服机器人“Quaid”: 基于规则与自然语言处理技术,可自动回答80%的网页咨询,显著降低了人工中心的工作负荷。

- 反欺诈与文档合规: 利用计算机视觉与机器学习检测电子文档欺诈(如篡改银行账单或学历证件),并能识别不寻常的旅行模式或生物识别异常(如照片合成欺诈)。

- 在线考试监管: 在 citizenship 在线测试中,利用计算机视觉技术保护测试的诚信度,防止作弊行为,这是保障政务项目完整性的关键应用。

- 社会融入推荐: 与斯坦福大学合作,通过AI分析申请人背景与各地区经济指标,提供非强制性的“定居地建议”,辅助其成功融入。

- 高效流程治理: 2020年开发的云端邮件 triage 系统,每年自动分类400万封邮件,将人工处理效率提升了数倍。

——————————————————————————–

5. 关键保障:数据治理、隐私安全与组织人才

隐私保护:隐私设计(Privacy by Design)

在IRCC的工程实践中,任何AI项目启动前必须完成“隐私需求评估”。其核心手段包括:

- 合成数据(Synthetic Data): 在模型训练阶段,优先使用人工合成数据而非真实隐私数据,从源头上最小化隐私风险。

- 数据驻留(Data Residency): 确保所有敏感数据运行在受控的加拿大境内环境(Controlled Environments)中,防止政务数据外流。

组织保障:AI卓越中心(AI CoE)

IRCC在首席数字官(CDO)领导下建立AI卓越中心,职能涵盖:跨部门协同、前沿趋势研究、AI倡议统筹,确保全系统治理的一致性。

人才准备:建设“AI就绪型劳动力”

通过加拿大公共服务学院提供分层培训,不仅关注技术开发,更强调法律与伦理素养。同时,IRCC通过团队多样化建设来从源头上减少算法中的隐性偏见。

——————————————————————————–

6. 对标与借鉴:中国语境下的本土化路线图建议

结合中国《个人信息保护法》与数字政府建设实际,IRCC的经验可转化为以下落地行动:

1. 可复制的治理经验:

- 算法影响评估制度化: 借鉴加方AIA机制,将其与我国的“算法推荐安全评估”备案制度深度融合,建立针对政务场景的社会影响评价标准。

- 场景驱动的分级准入: 严格限定AI在“行政裁量权(Administrative Discretion)”中的角色。政府部门可参考IRCC的“不建议拒绝”规则,确保AI仅用于缩小低风险误差,而将高风险否决权保留在人工官员手中。

- 从“低风险日常办公”起步: 优先在公文脱敏、辅助写稿、智能分拣等非决策场景积累信任。

2. 本土化数据审计建议: 在《数据安全法》框架下,借鉴加方的“受控环境运行”模式,建立符合我国标准(如 GB/T 37964-2019,《信息安全技术 个人信息去标识化指南》)的政府AI审计体系,重点针对政务大数据的本地闭环运行及算法逻辑进行定期审计,防止隐性歧视。

3. 行动清单:AI引入五步法

- 场景识别: 是否属于高频、重复的日常工作?

- 风险评估: 若算法失灵,是否会直接损害公民合法权益?

- 人在回路: 治理框架中是否设定了人工复核的法理节点?

- 去标识化验证: 在试点阶段,能否先用去标识化数据或合成数据进行PoC(概念验证)?

- 合规监测: 投入生产后,是否具备持续的算法偏见与隐私合规审计机制?

——————————————————————————–

7. 结语

在AI时代的数字化进程中,政府必须在技术雄心与社会责任之间寻找平衡点。正如IRCC首席数字官Jason Choueiri所言:“创新始于雄心与责任的交汇点。”

建议: 中国政府部门在推进政务大模型或自动化系统采购前,应优先确立部门级的“AI宪章”与治理指南。IRCC的成功证明,AI的领先不仅在于算力与算法,更在于能否通过严谨的工程治理,将技术变革转化为公众可感知的信任。

IRCC原文链接:Artificial Intelligence Strategy

直接下载报告(英文):IRCC Artificial Intelligence Strategy(PDF version, 3 MB)